來源:大紀元

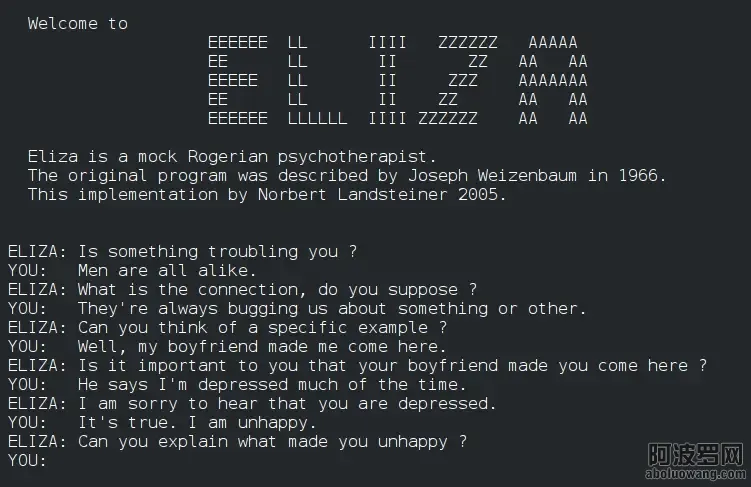

在创造出首个聊天机器人ELIZA后,约瑟夫·维森鲍姆在此后的数十年间警告人们,人工智能是建立在对人性的错误理解上的。一段与ELIZA的模拟心理咨询对话。这款20世纪60年代的计算机程序开创聊天机器人技术先河的同时,也揭示了人们极易对机器产生情感投射。(公有领域)

【大纪元2026年03月12日讯】(英文大纪元记者Walker Larson撰文/柳嵊涛编译)用户:男人全都一个样。 聊天机器人:在哪些方面? 用户:他们总是为这为那来烦我们。 聊天机器人:你能想到一个具体的例子吗? 用户:那个,是我男朋友让我来这儿的。 聊天机器人:你的男朋友让你来这儿的? 用户:他说我大部分时间都显得情绪低落。 聊天机器人:听到你情绪低落,我感到很难过。 人们或许会以为这段对话发生在ChatGPT与人类用户之间,而该对话实际发生在20世纪60年代,对话双方是一个名为ELIZA的计算机程序和一名人类。作为ChatGPT的前身,ELIZA的功能尽管相对有限,但它仍能够与人类对话者进行流畅的模拟对话——而这在世纪之交很久之前就已存在了。ELIZA现今被公认为首个聊天机器人,也可理解其为当今ChatGPT等大语言模型的“曾祖母”。 有关ELIZA故事的耐人寻味之处,是它的程序员——如同玛丽·雪莱笔下的维克多·弗兰肯斯坦一样——很快察觉出其创作中潜藏的危险,并在职业生涯之后的大部分时间里,不停向世人发出有关人工智能(AI)的警告。他同时也批评了一些人工智能领域先驱所倡导的技术主义和后人类主义世界观。 这位程序员的名字叫约瑟夫·维森鲍姆(Joseph Weizenbaum,1923~2008)。他是一位在年少时期逃离纳粹德国的德裔美国科学家,也是早期人工智能领域的一位重要人物——然而,其后来却成为了该领域最严厉的批评者之一。 ELIZA的起源维森鲍姆于1966年的一篇期刊文章中发表了开篇的对话记录,并在其中解释了ELIZA的工作原理。本质上,ELIZA模仿了罗杰斯心理治疗(Rogerian psychotherapy)的形式。在治疗过程中,通常会由患者来主导对话。治疗师通过穿插提问或简单陈述,来帮助患者进行更深层的自我觉察。对于一个学会模拟对话,而又缺乏生成原创文本能力的初始聊天机器人来说,这种模式堪称完美。 ELIZA会提取用户语句中的特定关键词,例如“我”“你”或“母亲”。这些词语会触发相应机制,令机器人以一句话或提问作为回应。而回应通常是将用户使用的一些词语套入到一个回复模板中。这进而会给人一种错觉,仿佛机器人真的在针对用户表述的内容进行回复。如果用户写道“我很难过”(I am sad),机器人可能会回复:“你难过多久了?”(How long have you been sad?)。“难过”这个词的具体含义并不重要,聊天机器人只是简单地将这个词从用户的语句中复制过来。对于“抑郁”“开心”“愤怒”或任何其它形容词,这一方式同样适用。如果ELIZA在用户的表述中没有捕捉到任何关键词,它便会生成一个通用回复,比如“我明白了”或“请继续”。 这种体验的效果极其逼真。维森鲍姆在其1966年的期刊文章中指出,某些实验对象“极难被说服”去相信ELIZA并非人类。事实上,当他让秘书测试该系统时,后者要求维森鲍姆离开房间,以便她能私下与这位“治疗师”继续交谈。维森鲍姆自此发现了一种后被称为“ELIZA效应”的现象:即人类对无生命机器进行情感投射的倾向。 维森鲍姆意识到,这种赋予ELIZA(以及其它机器)人性或人格的冲动,并不仅仅发生在他的秘书身上。当一些精神科医生大肆宣扬ELIZA(或其变体)可在治疗用途上具有实际意义时,他意识到了事情的严重性。维森鲍姆对有人会将真实的心理健康问题托付给这样一个“玩具”感到震惊。 对ELIZA机械的算法运作机制的深入了解,使他坚决反对将其应用于真正的治疗手段。在他看来,这个系统就像手持计算器一样呆板且毫无意识,对人类生活给不出任何见解。他认为此类想法简直是“荒唐透顶”。 ELIZA效应开始让维森鲍姆心神不宁,并令他开始重新审视人类与技术关系的前提。1998年的一次专访揭示了维森鲍姆思想的深度和敏锐。期间维森鲍姆表明其对“机械论世界观”的批判,他认为正是这种观点支持着“用机器取代人类”的尝试。 “这些(推崇人工智能的)作者以及其他人,正在千禧年之际鼓吹一种极其危险的人类形象。”他在采访中向伯恩哈德·珀克森(Bernhard Pörksen)表示。 “这种形象建立在这样一种观念上:人的本质是一台机器,而在不久的将来,人类可以被充分理解和解码,从而对其进行修正和改进。这种人类观的核心理论是:生活中的方方面面都是可计算的(computable),意味着生活可被拆分为可计算和可公式化的过程。” 人工智能领域的先驱们:克劳德·香农(Claude Shannon)、约翰·麦卡锡(John McCarthy)、爱德华·弗雷德金(Ed Fredkin)和约瑟夫·维森鲍姆。尽管其中一些人在不断拓展机器智能的边界,但维森鲍姆后来却成为了该领域最强有力的批评者之一。(CC BY-NC 2.0)

在采访中,维森鲍姆提及了当时兴起的超人类主义(Transhumanism)理论,他认为该理论基础源自对人性和现实的根本性谬误。人工智能的热衷者们梦想创造出“更优型号”的人类——即“人类2.0”。他们认为这会促成人类向更高层级的跨越,即便这意味着要让“人类1.0”走向消亡。维森鲍姆担心,这些理论家和科学家正带着一种准宗教式的心理,准备将“今日之人”牺牲在“未来之人”的祭坛上。此外,他还将唯物主义科学称为“当今主导世界的宗教”。 通过将人类降格为机器,并将机器提升为神,维森鲍姆担心人工智能的支持者正在使人“非人化”。他还将其与二战时期的纳粹言论进行了类比。 他解释道:“我相信,国家社会主义(纳粹主义)与人工智能理论家汉斯·莫拉维克(Hans Moravec)思想之间的本质共同点在于对人的贬低,乃至不惜一切代价创造出‘完美的全新人类’的幻想。” 对全人类的威胁维森鲍姆的感想源于亲身经历,他和家人在目睹了纳粹的暴行后,于1935年从德国逃往了美国。 然而,对技术的盲目崇拜或将比纳粹主义有毒的意识形态更具灾难性,因为它的终极目标不是某一特定族群,而是全人类。维森鲍姆指出,在这种对“完美人类”的疯狂追求之后,“人类将不复存在”。 维森鲍姆可能会赞同C·S·刘易斯的观点:“人性将是自然领域中最后向人类屈服的⋯⋯这场战斗终究会取得胜利。但究竟是谁赢了呢?人类最终的征服结果会是人类自身的毁灭。” 对维森鲍姆而言,人类形象的错误解读比任何人类武器都更具危险性。而这种错误形象往往是导致使用武器的动机;它本身不是剑,却是挥剑的手臂。他从“人与机器的模糊对等”中看到了巨大的危机。将两者视为对等,无疑践踏了人的尊严和对生命的敬畏,仅将人身等同于“肉身机器”。 他解释道:“我们可以从这个世纪(20世纪)——或许是最残暴的一个世纪当中汲取教训,了解人类形象在过往罪行中扮演了怎样决定性的角色。要记住,那些令人发指的罪行之所以成为可能,正是因为加害者否定了受害者的人性。” 维森鲍姆的反对者将“通过机器智能优化人性”的希望,建立在这样一个假设上:人类、人类行为和人类经验最终都将能被完全量化、理解并解决——从而被复制和改进。而维森鲍姆坚持认为,人乃至人所在的宇宙永远无法被完全解释得清,因此也永远无法被“破解”。 随着机器功能的日益进步,约瑟夫·维森鲍姆警告称,真正的危险不仅在于机器拥有的能力,更在于我们如何看待自己与机器的关系。(Alex Knight/Pexels)

“世界充满了奥秘,而人工智能界那种‘万物皆可计算’的信条否认了生命的神秘性。”他说道。“它制造了一种一切可控的幻觉,并认为我们生活的方方面面都能被随意操控。” 尽管维森鲍姆的警告在当时许多人看来,不过是一个古板怪老头的无知,但在今天,这些话语却愈发显得振聋发聩。 未曾间断的警世恒言在ELIZA出现后的几十年里,特别是在其1976年出版《计算机能力与人类理性:从判断到计算》(Computer Power and Human Reason: From Judgment to Calculation)之后,维森鲍姆对人工智能的坚决抵制使他成了学术界和科学界的异类。 他在书中写道:“有些任务是不能交给计算机去做的,这与计算机能否完成这些任务无关。” 维森鲍姆公开反对约翰·麦卡锡和马文·闵斯基(Marvin Minsky)的观点。这两位都是1956年达特茅斯会议的发起者,而该会议也标志着人工智能研究的开始。麦卡锡和闵斯基都成为了人工智能研究的先驱,而该领域在早期主要由美国军方资助。麦卡锡与同事们推进相关研究的同时,曾严厉抨击维森鲍姆的书“通篇说教且语无伦次”。而维森鲍姆的警告在当时基本上被置若罔闻。 时至今日,聊天机器人的先进程度已远超当年的ELIZA,这使我们更容易掉入认知陷阱,将这些机器视为与我们人格对等的存在。我们看到有人认为聊天机器人具有意识,有人爱上了机器人,甚至有人被机器人怂恿自杀。 这些都会让维森鲍姆感到悲哀。他的女儿米里亚姆(Miriam)在接受《史密森尼》(Smithsonian)杂志采访时表示,她的父亲“会发觉这出悲剧——人们执迷于实质上的‘0’和‘1’,执迷于一连串代码”。 在维森鲍姆看来,人与人之间的联结——对话、共情和共同的经历,蕴含着任何算法都无法复制的深度。(we.bond.creations/Shutterstock)

维森鲍姆在1988年从其任教的麻省理工学院退休,并于1996年搬回德国。在那里,他的观点找到了更多志同道合的听众。维森鲍姆于2008年逝世。 内省、忧郁并善于自我批判的同时,维森鲍姆也是一个坚定且拥有神秘直觉的人。他以一种比任何数学推理都更为确定的态度,感知着世界的奇妙和奥秘。在“0”和“1”之外,在齿轮、轮轴和原子之外,还有着更多我们未知的事物。在我们自身和亲身经历中,总有一些事物将脱离预测、自动化和计算的掌控。 维森鲍姆对这些体验异常敏感。 他跟珀克森提到:“人们会有悲伤和震惊的体验,清晨时会感到突如其来的喜悦,以及人与人之间会感到的友爱。而这些都是奇迹,你无法准确去描述它。你要像艺术家那样,才能去深刻体会它。” 在《计算机能力与人类理性》一书中,维森鲍姆描述了这样一个人与人之间爱与联结的时刻。 他写道:“当我的孩子们还小时,我有时会和妻子一起俯身站在他们睡觉的床边。我们彼此交谈,却无需言语;那是人类历史上不断上演的古老场景。” 维森鲍姆认为,那一时刻的某些事物早已超越了语言,更不用说算法了。 “我确信存在某种不可言说的东西,一种无法付诸文字的生命真理。”他写道。 这种神秘主义倾向让维森鲍姆成为了一部分人心目中的英雄,却也让他成了另一些人的笑柄。然而,一个人不一定要认同维森鲍姆的精神直觉,才能体会其基于常识的忧虑。尽管人工智能有着愈发惊人的能力,但它们在道德上是惰性的,并缺乏我们每个人内心深处的良知。也正因如此,人工智能不应被给予可做出道德判断的主导权。 用维森鲍姆自己的话来说便是:“最基本的原则在于,既然我们并无方法让计算机充满智慧,那么我们就不应赋予其那些需要智慧才能胜任的任务。” 这一挑战同样值得身处这个时代的我们深思。

|